Meta Movie Gen AI do tworzenia i edycji wysokiej jakości wideo oraz dźwięku na podstawie tekstowych podpowiedzi (promptów), a także do personalizacji treści przy użyciu zdjęć użytkowników.

Meta Movie Gen to rodzina modeli generatywnej sztucznej inteligencji opracowana przez Meta, wprowadzona 4 października 2024 roku. Jest to odpowiedź Meta na konkurencyjne narzędzia, takie jak Sora od OpenAI, i ma na celu zrewolucjonizowanie tworzenia multimediów, oferując zaawansowane możliwości zarówno amatorom, jak i profesjonalistom.

Kluczowe cechy:

- Movie Gen Video:

- Model o 30 miliardach parametrów, generujący wideo w rozdzielczości 1080p przy 16 FPS, o długości do 16 sekund.

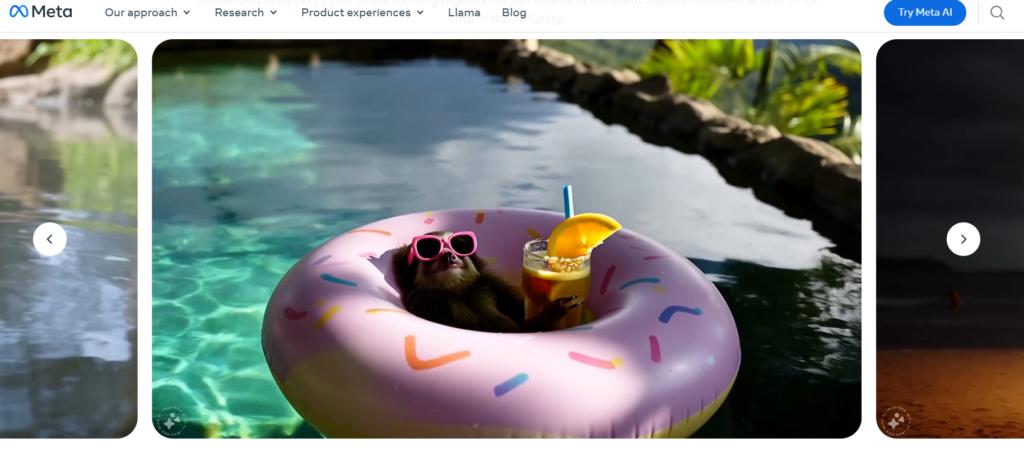

- Tworzy realistyczne klipy z tekstu, np. „mały hipopotam pływający w rzece z kolorowymi rybami” czy „kobieta DJ w różowej kurtce z gepardem obok”.

- Obsługuje precyzyjne ruchy kamery i fizykę świata rzeczywistego, choć czasem ma trudności z bardzo złożonymi scenami (np. manipulacja obiektami czy symulacje fizyczne).

- Movie Gen Audio:

- Model o 13 miliardach parametrów, generujący wysokiej jakości dźwięk (48 kHz) zsynchronizowany z wideo, w tym efekty dźwiękowe, muzykę tła i ambient.

- Działa do 45 sekund, z techniką rozszerzania audio dla dłuższych klipów.

- Personalizacja:

- Umożliwia generowanie spersonalizowanych wideo na podstawie zdjęcia osoby, np. przekształcając statyczny portret w scenę malowania na płótnie.

- Edycja wideo:

- Pozwala na precyzyjne zmiany w istniejących klipach za pomocą tekstu, np. dodanie pomponów do rąk biegacza czy zmiana tła na pustynię.

Jak działa?

Modele Movie Gen opierają się na architekturze transformatorowej z technikami dyfuzyjnymi i „Flow Matching”, co pozwala na płynne generowanie ruchu i synchronizację audio-wideo. Zostały wytrenowane na mieszance licencjonowanych i publicznie dostępnych zbiorów danych (szczegóły nieujawnione), co budzi pytania o etykę i legalność wykorzystanych źródeł.

Porównanie z konkurencją:

Meta twierdzi, że Movie Gen przewyższa modele takie jak Runway Gen-3, Luma Dream Machine, Kling 1.5 czy Sora w testach ludzkiej oceny pod kątem realizmu, zgodności z promptami i jakości ruchu. Na przykład, w porównaniu do Sory, Movie Gen lepiej oddaje szczegóły ruchu i unika „kreskówkowych” zniekształceń.

Dostępność 2025:

- Obecnie Movie Gen nie jest publicznie dostępny – pozostaje w fazie badawczej. Meta współpracuje z twórcami, m.in. z Blumhouse Productions i reżyserami jak Aneesh Chaganty czy Casey Affleck, testując model w praktyce.

- Planowana integracja z produktami Meta (np. Instagram) ma nastąpić w 2025 roku, ale firma podkreśla konieczność dalszych ulepszeń i zapewnienia bezpieczeństwa przed szerszym udostępnieniem.

Zastosowania i wyzwania:

- Zastosowania: Od tworzenia treści na media społecznościowe, przez prototypowanie filmowe, po personalizowane kampanie marketingowe.

- Ograniczenia: Model ma trudności z synchronizacją audio w subtelnych ruchach, złożoną geometrią scen czy realistycznymi symulacjami fizycznymi (np. topnienie obiektów).

- Etyka: Brak transparentności co do danych treningowych budzi obawy o naruszenia praw autorskich, podobnie jak w przypadku innych modeli AI. Meta nie planuje otwartego udostępnienia kodu (w przeciwieństwie do Llama), citing potencjalne ryzyka, jak deepfake’i.

Movie Gen ustanawia nowy standard w generatywnej AI, łącząc wideo i dźwięk w sposób wcześniej niedostępny w otwartych modelach. Choć nie jest jeszcze gotowy dla mas, jego potencjał może zmienić sposób, w jaki tworzymy i edytujemy multimedia, pod warunkiem rozwiązania kwestii technicznych i etycznych.